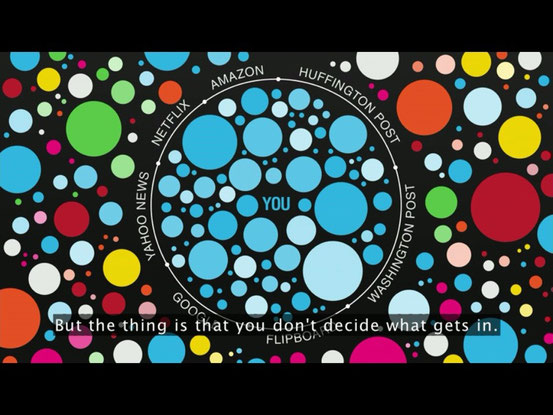

Schon seit geraumer Zeit bieten Suchmaschinen (Google) und Internetplattformen (Amazon) personalisierte Vorschläge zu Produkten, Webseiten und Informationen an. Diese Vorschläge beruhen auf persönlichen und Metadaten, welche aus früheren Suchanfragen, Konsum- und Bewegungsverhalten sowie dem sozialen Umfeld gewonnen werden. Heute wissen Algorithmen, was wir tun, was wir denken und wie wir uns fühlen – vielleicht sogar besser als unsere Freunde und unsere Familie, ja als wir selbst. Oft sind die unterbreiteten Vorschläge so passgenau, dass sich die resultierenden Entscheidungen wie unsere eigenen anfühlen, obwohl sie fremde Entscheidungen sind. Tatsächlich werden wir auf diese Weise immer mehr ferngesteuert. Je mehr man über uns weiß (Big Data), desto unwahrscheinlicher werden freie Willensentscheidungen mit offenem Ausgang.

Personalisierte Informationen bewirken, dass das Individuum vom System nur noch solche Vorschläge unterbreitet bekommt, die "hinreichend kompatibel" mit seinen eigenen Wünschen und Ideen sind (Resonanzeffekt). In Folge bekommt man nur noch seine eigenen Geschmäcker und Meinungen widergespiegelt. Eine Gesellschaft kann so tatsächlich schleichend in isolierte Subsysteme zerfallen, die sich gegenseitig nicht mehr wirklich verstehen und auch nicht kompromissbereit sind (Echokammereffekt). Auf diese Weise kann personalisierte Information den gesellschaftlichen Zusammenhalt unabsichtlich zerstören. Beobachten lässt sich das bereits in der amerikanischen Politik, wo Demokraten und Republikaner zusehends auseinanderdriften, so dass politische Kompromisse kaum noch möglich sind. Die Folge ist eine Fragmentierung, vielleicht sogar eine Zersetzung der Gesellschaft.

Man kann sich nun leicht vorstellen, dass solche Selektionseffekte und der Aufbau von "intellektuellen Echokammern" nicht nur durch profitorientierte Unternehmen immer weiter fortentwickelt werden, die einfach nur ihre Kunden kontrollieren und ausbeuten wollen. Man kann sich auch denken, dass eine künstliche Intelligenz, die wir vielleicht sogar in einer immer komplexer werdenden globalen Krisensituation als Ultima Ratio zum rationalen Social Engineering einsetzen wollen, solche Resonanzeffekte eigenständig optimiert um – durchaus in unserem eigenen Interesse – nachhaltige Meinungsumschwünge auf gesamtgesellschaftlicher Ebene zu erzeugen. Könnten wir das angesichts existenzieller Risiken – denken wir nur an die globale Erwärmung – vielleicht einmal selbst wollen, weil wir einfach keinen anderen Ausweg mehr sehen?

Aufgrund des Resonanzeffektes und des kognitionspsychologischen Bestätigungsfehler können Meinungsumschwünge – auch durch KI-Systeme – nur langsam und allmählich erzeugt werden. Auswirkungen, etwa des Big Nudging, treten mit zeitlicher Verzögerung ein, lassen sich dann aber auch nicht mehr so schnell rückgängig machen. Personalisierte Informationen können beispielsweise das Nationalgefühl massiv bestärken und somit letztendlich Diskriminierung und Konflikte fördern. Noch schwerer wiegt der Umstand, dass manipulative Methoden die Art und Weise verändern, wie wir unsere Entscheidungen treffen. Sie setzen nämlich die sonst bedeutsamen kulturellen und sozialen Signale außer Kraft – zumindest vorübergehend. Zusammengefasst könnte der großflächige Einsatz manipulativer Methoden also schwer wiegende gesellschaftliche Schäden verursachen, einschließlich der ohnehin schon verbreiteten Verrohung der Verhaltensweisen in der digitalen Welt.

Zudem tangiert Big-Nudging noch einige relevante Gesetze, da es offensichtlich ähnlich funktioniert wie personalisierte Werbung. Werbung muss als solche gekennzeichnet werden und sie darf nicht irreführend sein. Auch sind nicht alle psychologischen Tricks wie etwa unterschwellige Reize erlaubt. So ist es untersagt, ein Erfrischungsgetränk im Kinofilm für eine Zehntelsekunde einzublenden, weil die Werbung dann nicht bewusst wahrnehmbar ist, während sie unterbewusst vielleicht eine Wirkung entfaltet. Doch ist Big Nudging nicht genau das? Personalisierte Werbung, die unsere individuellen Schwächen ausnutzen und unsere kritisches Urteilskraft umgehen möchte? Auch Nudge-Versuche müssen als solche identifizierbar sein, selbst wenn ihre Ziele noch so heroisch sind.

In den Bereich personalisierte Daten fallen auch personalisierte Preise. Auch deren Rechtmäßigkeit kann angezweifelt werden (Missbrauch von Insiderinformationen, mögliche Verstöße gegen Gleichbehandlungsgrundsatz, Diskriminierungsverbot, Wettbewerbsrecht usw.) Der Sachverhalt ist mit Unternehmen vergleichbar, die ihre Produkte in Land A billiger verkaufen als in Land B, jedoch den Erwerb ihrer Produkte von Land B aus Land A zu verhindern versuchen. In solchen Fällen gibt es normalerweise empfindliche Strafzahlungen – wann wird Amazon für all das belangt?

Insgesamt beobachte ich in der digitalen Welt folgendes Phänomen: Wenn intelligente Systeme in offenen Umwelten erfolgreich agieren sollen, dann werden wir in kleinen Schritten immer größere Teile unserer eigenen Autonomie an sie abgeben müssen. Jeder einzelne dieser kleinen Schritte mag für sich genommen rational erscheinen: Big-Nudging zB. ist möglicherweise die einzige Methode, Bürger ohne(?) autoritären Mittel zu mehr Nachhaltigkeit und Friedfertigkeit zu erziehen. Aber auch wenn jeder Schritt für sich genommen sinnvoll erscheint, bringen sie uns in Summe möglicherweise in eine Welt, die wir gar nicht haben wollten.

Das ist meine Befürchtung. Wie können wir eine solche negative Entwicklung antizipieren? Auf gesamtgesellschaftlicher Ebene ist da bestimmt vieles denkbar, schließlich haben wir die digitale Entwicklung (noch) weitestgehend in den eigenen Händen. Aber wie trägt man ein solches Problem wie KI-Entwicklungen und Superintelligenzen erst einmal auf die gesamtgesellschaftliche Ebene? Mit meinem kleinen Blog sicherlich nicht. Aber auch das „Wachrütteln“ auf größeren Plattformen wie ARTE oder TED-Bühnen scheint mir immer weniger eine effektive Option zu sein. Am Beispiel des Klimawandels sehen wir, dass Transparenz und kühlrationale Aufklärung nicht alles sind. Die Information ist allgegenwärtig, sie springt uns seit vielen Jahren förmlich ins Gesicht, und gleichzeitig fahren erwachsene Leute mit Geländewagen zum Supermarkt um die Ecke, ohne sich zu schämen. Aber was braucht es noch, damit sich was ändert? Populismus? Zwang? Ich weiß es nicht.

Philoclopedia

Philoclopedia

Philoclopedia (Mittwoch, 01 September 2021 16:15)

A relevant paper by Thi Nguyen: https://aeon.co/essays/why-its-as-hard-to-escape-an-echo-chamber-as-it-is-to-flee-a-cult

(the academic article is a bit longer, this write up is a good summary.)

WissensWert (Montag, 09 April 2018 01:23)

"Wir haben es also auf der einen Seite mit Menschen zu tun, die sich ganz furchtbar um die Demokratie sorgen, weil es zu viele Filterblasen gibt, und gleichzeitig nicht mit Menschen mit anderen Ansichten reden wollen."

https://arprin.wordpress.com/2018/04/08/die-angst-vor-filterblasen/

WissensWert (Samstag, 06 Mai 2017 22:28)

http://www.sueddeutsche.de/digital/der-facebook-faktor-testen-sie-ihre-filterblase-1.3474022